ИИ 2025 — от интерполяции к энтропии и новой экономике

После просмотра подкаста (Коняев - чума!) я вроде понял, в чём минус ИИ, и провёл небольшое исследование этого вопроса. Ниже - обзорная статья, которая охватывает фундаментальные ограничения современных LLM через призму интерполяции и энтропии, технологические прорывы 2025 года, рыночную динамику ключевых игроков (Google, Broadcom, Intel), экономику вычислений и революционные перспективы развития ИИ.

1. СУТЬ ОГРАНИЧЕНИЙ ТЕКУЩЕГО ИИ: ИНТЕРПОЛЯЦИЯ VS ЭНТРОПИЯ

Интерполяция: Ловушка «среднего арифметического»

ИИ обучается на гигантском массиве данных (интернет, книги, код). Математически процесс генерации ответа - это поиск статистически наиболее вероятного пути между точками в многомерном пространстве признаков.

В чем минус: ИИ филигранно работает внутри известного распределения данных. Он усредняет опыт человечества. Если вы просите его написать «стихотворение в стиле Пушкина», он интерполирует между существующими текстами. Он не создает новое, он заполняет пустоты между имеющимся.

Результат: «Гладкие», правдоподобные, но часто вторичные и предсказуемые ответы. Это «интеллектуальный консерватизм».

Энтропия: Хаос, из которого рождается смысл

В термодинамике и теории информации энтропия - это мера неопределенности или хаоса. В контексте человеческого творчества энтропия - это способность сознания выдавать маловероятные, но ценные связи.

Почему ИИ боится энтропии: Разработчики ограничивают «температуру» (параметр случайности) ИИ, чтобы он не генерировал бессвязный бред (галлюцинации). Модель принуждают держаться ближе к наиболее вероятным токенам (интерполяции).

Человеческий фактор: Гениальность часто находится на грани высокой энтропии. Настоящее открытие - это всегда выход за пределы обучающей выборки (экстраполяция), а не усреднение внутри неё. Человек может создать нечто, чего никогда не было в его «датасете».

Главный конфликт: Статистика против Смысла

Интерполяция - это безопасное движение по проторенным дорожкам. Она эффективна для задач оптимизации, перевода, суммаризации и кодинга (где структура важнее новизны).

Энтропия (и экстраполяция) - это риск. ИИ не «понимает» физическую реальность, поэтому он не может отличить «гениальное безумие» от «просто безумия».

Вывод: Минус ИИ в том, что он - заложник прошлого. Он всегда смотрит в зеркало заднего вида, чтобы ехать вперед. Он стремится к снижению энтропии (к порядку и вероятности), в то время как живой интеллект растет за счет контролируемого хаоса и способности создавать новые смыслы там, где статистика видит нулевую вероятность.

Именно поэтому ИИ сегодня - это идеальный подмастерье, но (пока) сомнительный Творец. Он выдает «лучшее среднее», а нам иногда нужно «худшее, но уникальное».

2. ТЕХНОЛОГИЧЕСКИЙ СКАЧОК 2025 ГОДА

Индустрия сейчас находится на этапе перехода от «простого предсказания следующего слова» (интерполяции) к рассуждению и адаптивности. В 2025 году уже произошли и анонсированы несколько ключевых технологических сдвигов, которые пытаются преодолеть описанные ограничения.

1. Переход к «Scaling Law» времени вывода (OpenAI o1 и o3)

Раньше ИИ становился умнее за счет увеличения объема данных при обучении (интерполяция опыта). Теперь фокус сместился на test-time compute (вычисления во время ответа).

Что это дает: Модели вроде OpenAI o1 (известная ранее как Strawberry) используют «цепочку рассуждений» (Chain-of-thought). Вместо того чтобы мгновенно выдать статистически вероятный ответ, ИИ «думает» перед ответом, проверяет себя и исправляет ошибки в процессе.

Результат: Это первый шаг к тому, чтобы ИИ мог решать задачи, которых не было в обучающей выборке, путем логического вывода, а не простого усреднения.

2. Жидкие нейронные сети (Liquid Neural Networks)

Стартап Liquid AI (выходцы из MIT) активно разрабатывает архитектуру, которая кардинально отличается от классических трансформеров.

Суть: Параметры Жидких Нейронных Сетей (LNN) могут меняться в реальном времени при получении новых данных, в отличие от «замораживания» параметров после обучения в обычных моделях.

Значение: Это попытка решить проблему «статичности» ИИ. Модели LNN становятся более гибкими и способными адаптироваться к динамическим изменениям среды, что критически важно для робототехники и автономных систем. Летом 2025 года Liquid AI представили второе поколение своих моделей (LFM2), которые в разы эффективнее конкурентов.

3. Автономные агенты (Agentic AI)

В конце 2024 - начале 2025 года произошел «взрыв» в области AI-агентов.

Как это работает: В отличие от обычного чат-бота («голова в банке»), агент - это система, обладающая инструментами (доступ к браузеру, файлам, коду) и долгосрочной целью.

Сдвиг: Агенты используют итеративный подход. В случае неудачи они не просто повторяют заученное, а пробуют другой путь. Это снижает зависимость от интерполяции, поскольку система ориентируется на фактический результат своих действий в реальном мире.

4. Мультимодальность и «физический» интеллект

Современные модели (например, GPT-5.1 или новые системы от Meta) все больше уходят от чисто текстового обучения в сторону видео и сенсорных данных.

Зачем это нужно: Чтобы ИИ понимал не только статистику слов, но и причинно-следственные связи физического мира (интуитивную физику). Это необходимо для преодоления «галлюцинаций», вызванных чистой интерполяцией текста.

Итог: Технологический скачок 2025 года - это переход от «ИИ, который знает всё» к «ИИ, который умеет рассуждать и действовать». Мы учим модели не просто помнить ответы, а искать их с нуля, используя логику. Это и есть попытка обуздать «энтропию» и выйти за рамки привычного усреднения данных.

3. РЫНОК И ГЕОПОЛИТИКА (ALPHABET, BROADCOM, INTEL)

Google (#GOOGL): Доминирование за счет интеграции

Аргумент про клиентскую базу как ключ к победе Alphabet (Google) в 2025 году находит подтверждение, но стратегия компании теперь шире, чем простое использование охвата.

1. Доминирование за счет «скрытого внедрения»

Google использует свою клиентскую базу для внедрения ИИ. Это не требует от пользователей входа в новые приложения.

-

AI Overviews: AI Overviews охватывает более 1,5 миллиарда пользователей по всему миру. Более 50% поисковых запросов в 2025 году уже сопровождаются ответами ИИ, что делает его самым массовым генеративным продуктом в истории.

-

Экосистема Workspace: Интеграция Gemini в Docs и Gmail позволяет Google удерживать корпоративных клиентов, предлагая ИИ в привычном рабочем пространстве. Это создает высокие барьеры для перехода к конкурентам.

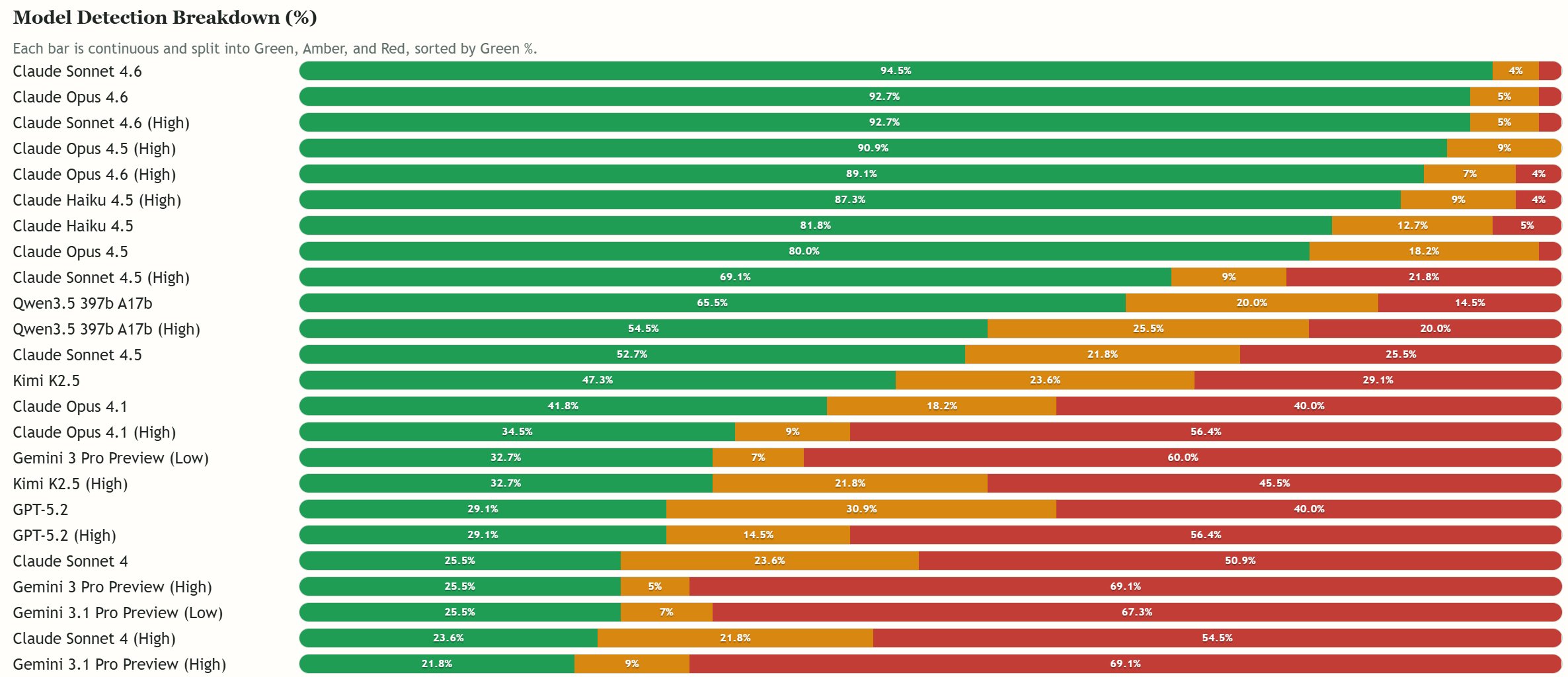

2. Технологический ответ: Gemini 3 против GPT-5

Google находится наравне с OpenAI.

-

Gemini 3 (ноябрь 2025): Новейшая модель лидирует в мультимодальности, подразумевая обработку видео, аудио и изображений. Благодаря большому контекстному окну (до 1 миллиона токенов), Gemini 3 способна анализировать целые библиотеки кода или часы видео.

-

Вердикт тестов: Согласно тестам, к концу 2025 года Gemini 3 часто опережает GPT-5.2 в задачах генерации контента и работы с данными. GPT-5 все еще сохраняет лидерство в логическом рассуждении и программировании.

3. Инфраструктурное преимущество

Google разрабатывает собственные TPU (Tensor Processing Units) с 2015 года. Конкуренты Google зависят от поставок чипов Nvidia.

-

Разработка собственных TPU позволяет Alphabet снижать себестоимость генерации ответов. Также это обеспечивает вычислительную мощность, необходимую для обучения моделей следующего поколения, таких как Gemini 3 Pro.

-

В 2025 году Google планирует направить около $75 млрд на капитальные затраты. Основная часть этих затрат будет направлена на ИИ-инфраструктуру. По этому показателю Google будет конкурировать с Amazon и Microsoft.

4. Новые игроки и угрозы

Несмотря на лидерство, «победа» не является абсолютной:

-

OpenAI: OpenAI выпустила собственный браузер в конце 2025 года, чтобы напрямую конкурировать с Chrome.

-

Anthropic (Claude): Anthropic (Claude) и новые игроки, такие как DeepSeek, забирают долю в нишевых глубоких исследованиях и кодинге.

-

Регуляторы: Правительство США остается главным риском, который может замедлить доминирование Google через антимонопольные иски.

Итог: Google эффективно конвертирует свою базу в лидерство за счет инфраструктуры и интеграции. К концу 2025 года Google сам стал главной силой, определяющей развитие рынка.

Производство TPU: Модель разделения труда

Для производства TPU (Tensor Processing Units) Google использует модель разделения труда: компания самостоятельно проектирует архитектуру чипов, но доверяет их детальную разработку и непосредственное производство опытным партнерам.

Основные партнеры по разработке (Design Partners):

-

Broadcom: Исторически главный партнер Google в разработке специализированных ИИ-чипов (ASIC). В 2025 году Broadcom помог в создании седьмого поколения TPU - v7 (Ironwood). Google является крупнейшим заказчиком Broadcom, обеспечивая более 80% продаж его ИИ-ускорителей.

-

MediaTek: В марте 2025 года Google официально расширил круг партнеров, заключив контракт с тайваньской MediaTek. MediaTek отвечает за разработку модулей ввода-вывода (I/O) для новых версий чипов (таких как v7e и будущая v8e). Это сотрудничество позволяет Google снизить зависимость от Broadcom и сократить расходы.

Физическое производство (Foundry):

-

TSMC (Taiwan Semiconductor Manufacturing Company): Непосредственное изготовление самих кристаллов. Современные поколения TPU (v6 и v7) производятся по передовым техпроцессам 3 нм и 5 нм. В 2025 году TSMC значительно увеличила мощности упаковки (CoWoS) специально под проекты Google, реализуемые через MediaTek.

Поставщики памяти:

-

Samsung: Основной поставщик высокоскоростной памяти (HBM3/HBM3E), которая критически важна для работы TPU. В 2025 году более 60% поставок памяти для этих чипов приходится на Samsung.

Итог: Google контролирует дизайн и логику, Broadcom и MediaTek превращают эти чертежи в готовые схемы чипов, а TSMC печатает их на кремнии. Эта стратегия позволила Google стать главным конкурентом Nvidia на рынке ASIC-ускорителей.

Broadcom (#AVGO): Падение акций в декабре 2025

Акции Broadcom (AVGO) резко упали (более чем на 12% за несколько дней) в середине декабря 2025 года. Основной причиной этой реакции инвесторов стал финансовый отчет за четвертый квартал, опубликованный 11 декабря 2025 года.

Ключевые факторы негативной реакции рынка, несмотря на превышение ожиданий по выручке и прибыли:

-

Давление на маржинальность: Руководство компании спрогнозировало снижение валовой прибыли (gross margin) примерно на 100 базисных пунктов в первом квартале 2026 года. Это объясняется тем, что быстрорастущий сегмент оборудования для искусственного интеллекта (ИИ) является менее прибыльным по сравнению с традиционным программным обеспечением компании.

-

«Недостаточный» объем заказов на ИИ: Портфель заказов (backlog) на ИИ-решения достиг $73 млрд. Однако некоторые аналитики посчитали эту цифру заниженной относительно сверхвысоких ожиданий рынка.

-

Риски импортозамещения у клиентов: Инвесторов обеспокоили комментарии генерального директора Хока Тана. Комментарии касались рисков перехода крупных клиентов на собственные разработки чипов (in-house design), что потенциально может снизить спрос на услуги Broadcom в будущем.

-

Общая ротация в секторе: Падение акций Broadcom было усилено на фоне общего выхода инвесторов из «перегретых» акций ИИ-сектора. К таким акциям относятся, в частности, Nvidia и AMD. Причиной для этого послужили слабые прогнозы Oracle и опасения относительно окупаемости капитальных вложений в ИИ.

Связь с Google:

Согласно данным аналитиков и отчетности за 2025 финансовый год:

-

Доля в выручке от ИИ-чипов (ASIC): Google является крупнейшим клиентом Broadcom в сфере ИИ. По оценкам экспертов (в частности, HSBC), на долю процессоров TPU (Tensor Processing Units) от Google приходится:

-

~78% выручки Broadcom в сегменте заказных ускорителей (ASICS) в 2025-2026 гг.

-

~58% от общего объема поставок всех специализированных чипов компании в штучном выражении.

-

-

Общий вклад в бизнес ИИ: В 2025 финансовом году выручка Broadcom от ИИ-решений достигла $20 млрд (рост на 65% за год). Значительная часть этой суммы генерируется за счет Google и их новых чипов шестого и седьмого поколений (включая проект Ironwood). Google позиционируется как один из трех «гиперскейлеров» (вместе с Meta и недавним контрактом с OpenAI), формирующих основной поток заказов на кастомные решения Broadcom.

-

Финансовая зависимость и риски: Высокая доля заказов от Google и других гигантов названа одной из причин недавнего падения акций Broadcom в декабре 2025 года. Перечислены конкретные риски:

-

Снижение маржинальности: Заказы Google на сборку серверных стоек (системный уровень) имеют более низкую валовую рентабельность по сравнению с чистой продажей ПО или чипов. Увеличение доли таких заказов привело к предупреждению о снижении маржи на 100 базисных пунктов.

-

Концентрация: Зависимость от нескольких крупных клиентов создает риски; слухи о том, что Google может перенести часть разработки «инхаус», вызывают волатильность акций AVGO.

-

Итог: Google обеспечивает более 20% всей выручки полупроводникового сегмента Broadcom. Google является критическим партнером, на которого завязано почти 80% успеха их самого прибыльного направления - ИИ-ускорителей.

Intel (#INTC): Потенциальный партнер Google

В 2025 году сценарий частичного переноса производства чипов Google на мощности Intel Foundry Services (IFS) перешел из гипотез в стадию обсуждений и первых шагов. По состоянию на декабрь 2025 года, вероятность частичного переноса производства чипов Google на мощности Intel Foundry (IFS) подкрепляется несколькими факторами.

Фактор 1: Дефицит мощностей у TSMC

Хотя Google в 2025 году перевела производство своих мобильных процессоров (Tensor G5 для Pixel 10) на TSMC, TSMC перегружена заказами от Apple и Nvidia. Google вынуждена диверсифицировать поставщиков для своих серверных ИИ-чипов (TPU), чтобы избежать дефицита.

Фактор 2: Продвинутая упаковка (Advanced Packaging)

Google рассматривает возможность использования технологии упаковки Intel EMIB для своих будущих ускорителей (в частности, для поколения TPU v9, ожидаемого к 2027 году). Упаковка - это то, как мелкие части чипа соединяются между собой. Технология Intel является одной из немногих реальных альтернатив решению CoWoS от TSMC, на которое стоит очередь из мировых IT-гигантов.

Фактор 3: Техпроцесс Intel 18A

В 2025 году Intel запустила в массовое производство свой самый современный узел 18А, который является аналогом 1.8 нм техпроцесса. Microsoft уже стала крупным клиентом этого техпроцесса. Аналитики прогнозируют, что к концу 2025 года Google вероятно, последует этому примеру. Причиной для этого называется тот факт, что Intel предлагает не только передовые технологии, но и заводы на территории США, что снижает геополитические риски и предоставляет налоговые льготы.

Фактор 4: Роль Broadcom и MediaTek

Google работает через посредников: Broadcom для текущих TPU и MediaTek для будущих версий. Если Intel Foundry сможет предложить Google более выгодные условия или доступные производственные квоты, Broadcom может адаптировать дизайн чипов Google под фабрики Intel.

Итог: Полного ухода от TSMC к Intel не будет. Вместо этого наиболее вероятным сценарием развития на 2026-2027 годы является «гибридная модель». Эта модель включает:

-

Проектирование чипов с Broadcom/MediaTek.

-

Производство у TSMC.

-

Упаковка или производство части компонентов у Intel.

Целью такой гибридной модели является снижение зависимости Google от одной фабрики в условиях «гонки вооружений» в сфере искусственного интеллекта.

Samsung: Ключевой поставщик памяти

Samsung является основным поставщиком высокоскоростной памяти (HBM3/HBM3E), которая критически важна для работы TPU. В 2025 году более 60% поставок памяти для этих чипов приходится на Samsung. Акции торгуются на Корейской бирже (KRX: 005930) и в США в виде ADR (OTC: SSNLF).

4. ЭКОНОМИКА ВЫЧИСЛЕНИЙ

Рост запросов на вычисления на порядки

Переход от простой статистической интерполяции к глубокому рассуждению (reasoning) - это смена парадигмы, которая в 2025 году вызвала взрывной рост спроса на вычислительные мощности. Этот процесс описывается концепцией Inference Scaling Laws (законы масштабирования во время вывода).

1. Рост вычислений на порядки

Если ранее основная нагрузка приходилась на обучение модели, то теперь фокус сместился на инференс (генерацию ответа).

Пример: Модели нового поколения, такие как OpenAI o1 и o3, тратят в десятки раз больше времени и ресурсов на один ответ, чем обычные GPT-4. Исследования декабря 2025 года показывают, что модели с функциями глубокого рассуждения потребляют в среднем в 30 раз больше энергии на 1000 промптов, чем их «быстрые» предшественники.

Суть: Для того чтобы «победить энтропию» и дать не просто вероятный, а логически верный ответ, ИИ должен запускать тысячи внутренних циклов проверки, поиска и самокоррекции, что требует экспоненциально больше операций.

2. Инфраструктурный кризис 2025 года

Этот скачок уже привел к тому, что главным ограничителем развития ИИ стали не алгоритмы, а физика:

-

Энергопотребление: По прогнозам на конец 2025 года, потребление энергии специализированными ИИ-модулями удвоится и достигнет 23 ГВт - это эквивалентно всему энергопотреблению Нидерландов.

-

Дефицит мощностей: Крупнейшие игроки (Google, Microsoft, OpenAI) планируют вложить более $1 трлн в инфраструктуру в ближайшие годы, включая гигантские проекты вроде ЦОД «Stargate» стоимостью $500 млрд.

3. Экономический сдвиг

Индустрия осознала, что масштабирование «времени раздумья» во время вывода гораздо эффективнее для решения сложных задач (математика, кодинг, наука), чем бесконечное увеличение обучающей выборки.

-

o3-pro: Флагманские модели конца 2025 года (например, o3-pro) могут «думать» над одним сложным запросом несколько минут, используя ресурсы, сопоставимые с целыми кластерами прошлых лет.

Итог: Мы входим в эру, где «интеллект» ИИ прямо пропорционален количеству сожженного электричества во время «размышления» над конкретной задачей. Это делает энергоэффективность и доступ к дешевой энергии (а не просто данные) главным фактором победы в ИИ-гонке.

Оптимизация расходов: Экономика токена

Стремительный рост энергопотребления и стоимости вычислений в 2025 году сделал «экономику токена» главным приоритетом для индустрии. Наблюдается масштабная волна оптимизации на всех уровнях - от архитектуры моделей до физики чипов.

1. Переход на специализированную архитектуру (Inference-native)

Вместо универсальных GPU индустрия переходит на чипы, заточенные исключительно под инференс (выдачу ответов), а не обучение.

-

LPUs (Language Processing Units): Компании вроде Groq в 2025 году показывают невероятную эффективность, заменяя GPU на архитектуру, которая обрабатывает текст в десятки раз быстрее и дешевле.

-

Кастомные чипы (ASICs): Google (TPU v6/v7), Amazon (Trainium 3) и Microsoft (Maia 100) всё активнее замещают дорогие решения Nvidia своими чипами, чтобы снизить себестоимость одного запроса на 40-60%.

2. Масштабирование эффективности (Inference Scaling Laws)

Если раньше модели становились умнее за счет увеличения размера (что дорого), то в 2025 году прогресс идет за счет оптимизации процесса «размышления»:

-

Спекулятивное декодирование (Speculative Decoding): Маленькая «черновая» модель быстро набрасывает ответ, а большая основная модель лишь проверяет его. Это позволяет снизить задержку и стоимость вычислений в разы, не теряя в качестве.

-

Дистилляция рассуждений (Reasoning Distillation): Флагманские модели (вроде OpenAI o1) обучают более компактные модели («студентов») имитировать их логические цепочки. Это позволяет запускать «умные» функции на гораздо более дешевом железе.

3. Смена парадигмы в железе: Nvidia Blackwell

В 2025 году массовое внедрение архитектуры Blackwell (B200) стало ответом на энергетический кризис. Новые чипы обеспечивают в 25 раз более высокую энергоэффективность при инференсе по сравнению с прошлым поколением (Н100). Это позволяет сократить операционные расходы на облачные вычисления почти в 10 раз при масштабном развертывании.

4. Оптимизация на уровне софта

-

Квантование (Quantization): Переход на сверхнизкую точность вычислений (FP4/FP6 вместо FP16) позволяет моделям занимать в 4 раза меньше памяти и работать в 2-3 раза быстрее на том же железе.

-

Агенты и «умное» планирование: Вместо того чтобы прогонять каждый запрос через самую мощную модель, системы-маршрутизаторы (routers) в 2025 году направляют 80% рутинных задач на дешевые малые модели (SLM), оставляя дорогие вычисления только для действительно сложных проблем.

5. Энергетический маневр

ЦОДы 2025 года строятся по принципу «Power-first»: близость к источникам дешевой энергии (АЭС, крупные солнечные фермы) стала важнее, чем близость к потребителю. Некоторые гиганты (Microsoft, Google) в конце 2025 года начали инвестировать в собственные малые модульные реакторы (SMR), чтобы зафиксировать стоимость электричества на десятилетия вперед.

Итог: Мы видим парадокс. Хотя суммарные запросы на вычисления растут, стоимость одного «умного» токена за последние два года упала более чем в 280 раз. Это гонка между ростом сложности задач и скоростью их удешевления.

5. РЕВОЛЮЦИОННЫЕ ПЕРСПЕКТИВЫ (ПОСЛЕ 2025)

Революционные шаги - это изменения, затрагивающие саму физику процесса или базовую математику, отказываясь от принципов, на которых ИИ строился последние 70 лет (архитектура фон Неймана и обратное распространение ошибки).

1. Оптические (фотонные) вычисления

Самый ожидаемый фундаментальный сдвиг, при котором данные передаются с помощью фотонов (света) вместо электронов по медным дорожкам (что вызывает нагрев и сопротивление).

Революция: Свет не имеет массы и почти не выделяет тепла при передаче. Компании вроде Lightmatter поставляют интерконнекты для ЦОДов уже в 2025 году.

Эффект: Потенциальное ускорение матричных вычислений в 100-1000 раз при снижении энергопотребления на порядки, что позволит «обуздать энтропию» без строительства новых электростанций.

2. Нейроморфные чипы (SNN - Spiking Neural Networks)

Современный ИИ работает циклично и постоянно потребляет энергию, в отличие от принципов работы человеческого мозга, где нейрон «вспыхивает» (спайк) только при наличии входного сигнала.

Революция: Переход к импульсным нейронным сетям, работающим «по событию».

Эффект: Возможность перенести мощный ИИ с уровня огромных дата-центров на уровень автономных устройств, позволяя ИИ с уровнем рассуждения GPT-5 работать от батареи смартфона месяцами.

3. Био-цифровые гибриды (Organoid Intelligence)

В 2024-2025 годах стартапы (например, FinalSpark) начали предоставлять облачный доступ к нейроплатформам, состоящим из выращенных в лаборатории человеческих нейронов.

Революция: Биологические нейроны справляются с неопределенностью и хаосом (энтропией) в миллионы раз эффективнее кремния. Они самообучаются «на лету» без миллионов итераций.

Эффект: Создание систем, способных к настоящей экстраполяции - поиску решений за пределами данных, на которых их «вырастили».

4. Отказ от Backpropagation (Forward-Forward Algorithm)

Джеффри Хинтон (отец современного ИИ) предложил отказаться от метода «обратного распространения ошибки», на котором работают все текущие LLM (большие языковые модели).

Революция: Вместо того чтобы прогонять гигантские массивы данных назад и вперед для настройки весов, новые алгоритмы (например, Forward-Forward) позволяют модели учиться в один проход, как это делает биологический мозг.

Эффект: Скорость обучения моделей вырастет в разы, а требования к памяти упадут, что сделает ИИ по-настоящему адаптивным в реальном времени.

5. Квантовый ИИ (Quantum Machine Learning)

К концу 2025 года квантовые компьютеры (IBM, Google) достигли уровня, когда их можно интегрировать в гибридные облака для специфических задач.

Революция: Квантовые биты (кубиты) идеально подходят для поиска глобального минимума в бесконечно сложных пространствах вероятностей.

Эффект: Там, где классический ИИ делает «интерполяцию» между точками, квантовый ИИ может мгновенно «увидеть» всю структуру данных и найти ответ, который физически невозможно вычислить классическим способом.

Итог: Если эволюция - это «быстрее и дешевле», то революция - это переход от «вычисления интеллекта» к его «физическому воплощению». Мы должны перестать пытаться имитировать разум через статистику и начать строить его на физических принципах, более близких к самой природе мышления.

-

Кому принадлежит Gemini?

-

Как работает Gemini?

-

Является ли Gemini точным?

-

Может ли Gemini помочь с конкретными задачами или вопросами?

-

Является ли Gemini бесплатным сервисом?

-

Можно ли использовать Gemini на мобильных устройствах?

-

Доступен ли Gemini на разных языках?

-

Как начать работу с Gemini?

Войти в Gemini: быстрый и безопасный доступ к вашему ИИ-помощнику

- Исследуйте возможности Gemini, передового ИИ от Google, созданного для преобразования вашей работы и творчества.

Что такое Gemini

- Gemini — это революционная разработка в области искусственного интеллекта, созданная компанией Google. Этот многофункциональный ИИ-помощник

Регистрация Gemini в России: Полное Руководство

- Gemini — это многофункциональный искусственный интеллект, способный генерировать тексты, переводить языки, писать код, анализировать данные и многое