Из лошади не сделать автомобиль: суровая правда об AGI, которую скрывают создатели ИИ

В начале проекта он кажется всемогущим демиургом. Но это ощущение проходит быстро и навсегда. Вот математическое доказательство того, почему ИИ никогда не заменит программистов.

У меня для вас две новости: одна хорошая, другая плохая.

Плохая новость: создать AGI на базе текущих LLM-моделей невозможно.

Хорошая новость: если вы являетесь экспертом в области, требующей высоких когнитивных навыков, вам, скорее всего, не грозит увольнение. Разве что Сэм Альтман, Дарио Амодей и Демис Хассабис уже успели проникнуть в голову вашего босса с громкими историями о том, что ИИ заменит каждого сотрудника.

Примечание: Помимо того, что я исследователь искусственного интеллекта, я также профессиональный веб-разработчик с многолетним опытом работы в аутсорсинговой компании. Эта статья основана на моем личном опыте в данной сфере.

Я постоянно слышу один и тот же рефрен: нынешнее поколение моделей творит чудеса. Вы просите ИИ создать какое-нибудь приложение, нажимаете «Enter» и идете за кофе. Когда возвращаетесь, все уже готово и отлично работает.

Как всегда - это сильное преувеличение. А порой - и просто фантазия.

Скажу больше: для ИИ, построенного на архитектуре GPT, такой результат недостижим - при условии, что мы говорим о реальном продукте, а не об игрушечной демо-версии с красивой оберткой.

Я уже много раз объяснял почему, но позвольте мне просто поделиться своими наблюдениями.

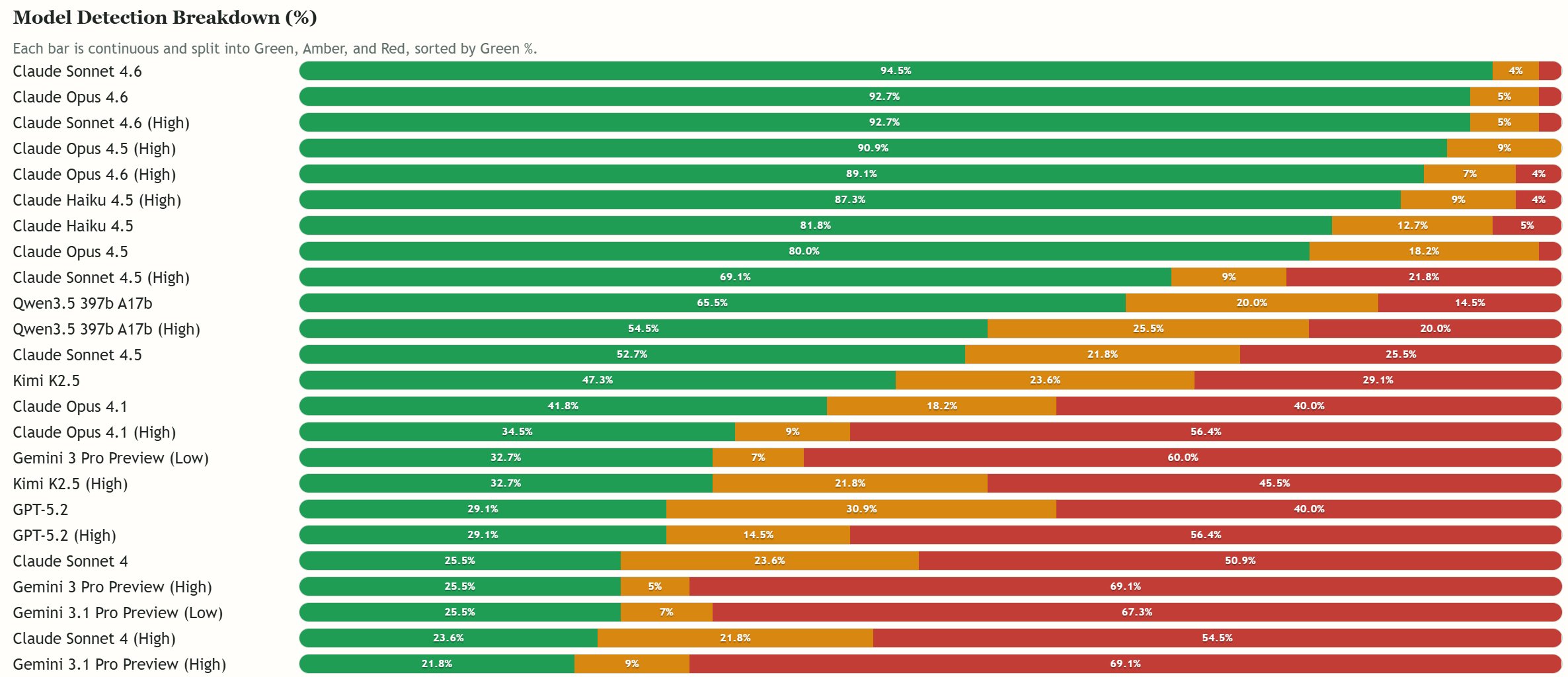

Разумеется, я использую ИИ в веб-разработке. Вот что я успел попробовать: Copilot, Cursor, Gemini Code Assist, Codex и Kilo. Я также пробовал Antigravity от Google, но он оказался излишне «умным». Короче говоря, ему было крайне сложно поддерживать со мной нормальный диалог.

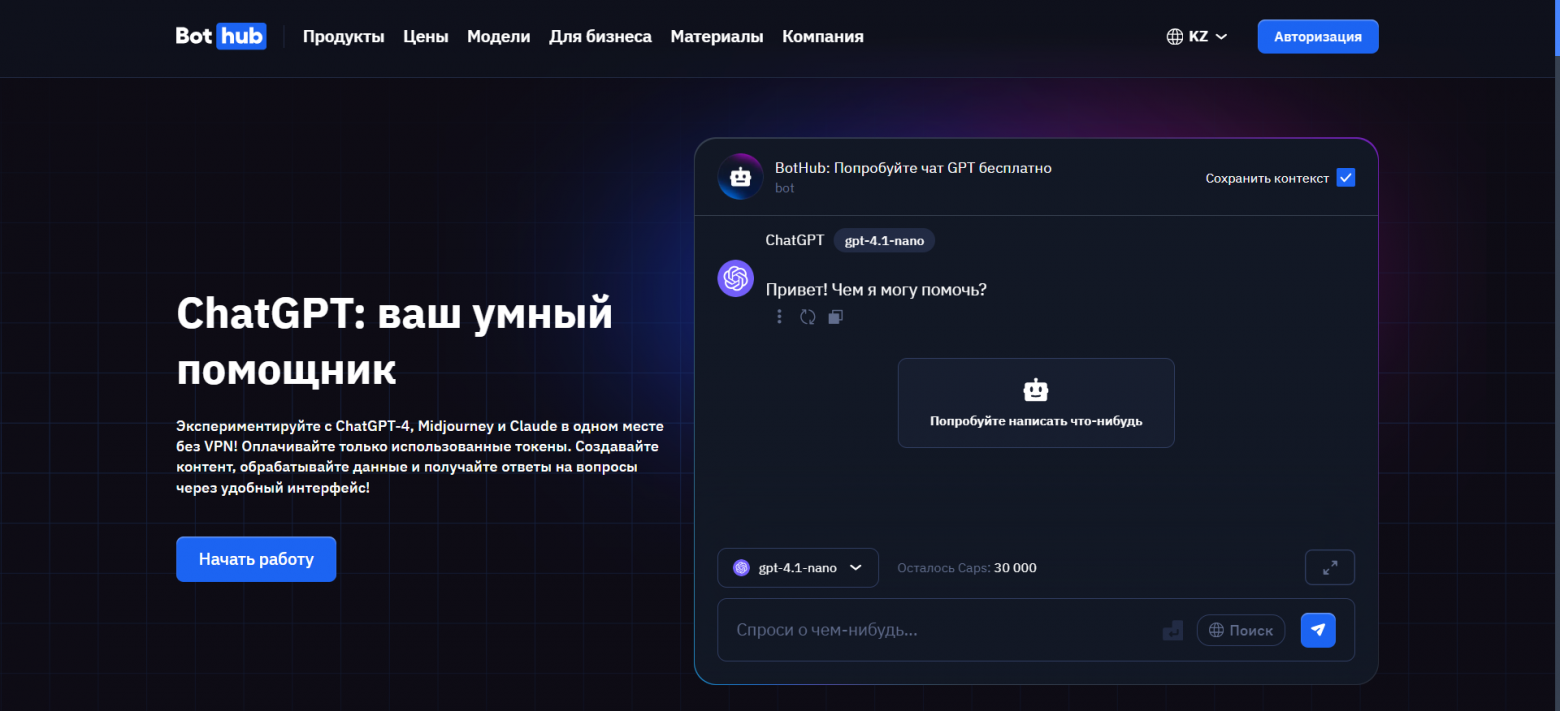

Кстати, о поиске идеального инструмента. Чтобы найти ту самую нейросеть, которая действительно ускорит вашу работу, а не заставит тратить время впустую, полезно иметь доступ к разным моделям.

Сервисы вроде BotHub дают возможность экспериментировать с передовыми ИИ (включая топовые модели для написания кода и анализа) в одном удобном окне.

Для доступа не требуется VPN, можно использовать российскую карту.

По ссылке вы можете получить 300 000 бесплатных токенов для первых задач и приступить к работе с нейросетями прямо сейчас!

Но давайте будем честны.

Конечно, если бы ИИ выдавал исключительно галлюцинации, им бы никто не пользовался. Но нет - во многих случаях он невероятно полезен. Я не собираюсь этого отрицать. Более того, я в полной мере осознаю сложность проблем, которые удалось решить разработчикам LLM. Я снимаю шляпу перед их инженерным гением.

Но.

Этого недостаточно. Мы ведь здесь не ради развлечения, верно? Нам нужны системы, которые будут эффективными, надежными и предсказуемыми.

И именно здесь LLM и генеративный ИИ сталкиваются с фундаментально неразрешимыми проблемами.

Самым надежным инструментом для меня пока остается Gemini Code Assist. Когда я только начал им пользоваться, я был поражен. В первые часы работы над новым проектом это похоже на магию: он работает блестяще. Он быстро пишет код и все объясняет. Его пояснения логичны и связны. Возникает чувство, будто ты разговариваешь не с алгоритмом, а с высококвалифицированным коллегой-программистом.

Значит ли это, что эра «человеческого программирования» подошла к концу, а AGI находится всего в одном шаге от нас?

Даже близко нет. И вы начинаете понимать это довольно быстро.

Как только ваш проект перерастает масштаб игрушечного примера, «магия» рассеивается. Вы задаете ИИ простой вопрос, и... он «думает». Сначала это терпимо. Иногда пять секунд, иногда десять. Но по мере роста проекта время на раздумья раздувается. Он может висеть минуту, две, пять. В конце концов, вы действительно можете сходить за тем самым кофе, пока он ищет ответ, который человек-эксперт выдал бы за секунды.

Если вы думаете, что это «баг» или «медленный сервер» - вы ошибаетесь. Это фундаментальный предел технологии и одно из доказательств того, что AGI, построенный на LLM - это не более чем красивая маркетинговая сказка.

Математика против хайпа

Так почему же ИИ начинает так сильно тормозить? Ответ кроется в самой архитектуре трансформеров. Это называется Механизмом внимания (Attention Mechanism).

В начале проекта контекст чист. Но чем дольше вы работаете, тем больше запрос. LLM не помнит ваш код так, как это делает человек; при каждом запросе она перечитывает все нижеперечисленное с нуля:

-

Историю чата.

-

Файлы.

-

Системные инструкции.

-

Индексы проекта.

Все это превращается в колоссальный массив данных. И вот тут в игру вступает физика: вычислительная сложность растет квадратично (O(n²)) по мере увеличения длины контекста. Увеличьте контекст вдвое - и нагрузка на графические процессоры возрастет в четыре раза. Увеличьте в десять раз - и система начнет пожирать ресурсы, как черная дыра.

Ваш ИИ-ассистент не размышляет над вашим кодом. Он просто пытается переварить терабайты математических операций, чтобы предсказать следующее слово. Он действует как сущность, запертая в замкнутой когнитивной петле.

Почему мозг программиста - это не «статистический калькулятор»

Это та самая граница, которую евангелисты ИИ отказываются признавать. Между человеком и системой LLM существует фундаментальная разница.

-

Программист не держит в голове 10 000 строк текста. Он держит в голове смыслы. Он понимает архитектуру, замысел и логику каждого решения. Для ИИ ваш проект - это просто плоская последовательность символов.

-

Человеческий мозг превосходно отсеивает нерелевантную информацию. А ИИ должен обработать каждый отдельный токен, который ему «скормили» в контексте.

-

Человек учится в процессе работы, тогда как LLM статична. Она не становится «умнее» от того, что три часа помогала вам с рефакторингом. Она просто сжигает больше энергии.

Ловушка «лошади и автомобиля»

Истинные адепты LLM скажут вам: «Модели станут лучше! Просто подождите GPT-6 или новую версию Gemini».

Это классическое заблуждение. Вы можете бесконечно выводить более быструю и выносливую породу лошадей. Но вы никогда не выведете автомобиль из лошади.

Масштабирование LLM - это путь количественного улучшения статистического предиктора. Но для создания истинного интеллекта (AGI) требуются:

-

Причинно-следственное мышление.

-

Автономная постановка целей.

-

Долгосрочная память, которая не сжигает электростанцию при каждом запросе.

Неудобная правда

Поначалу ИИ делает вас быстрее. Но в тот момент, когда сложность системы возрастает, скорость работы человека начинает опережать ИИ, который сам себя загнал в тупик. Вы тратите больше времени на составление промптов и ожидание ответа, чем на фактическое написание кода.

Надеюсь, теперь вы понимаете причину моих опасений. Мы строим экономику на инструментах, которые физически не могут масштабироваться соразмерно сложности наших задач. Сегодняшние ИИ-ассистенты - это мощные статистические зеркала, отражающие наш собственный интеллект. Но не путайте отражение с самим объектом.

Не верьте Сэму Альтману, когда он говорит, что к 2028 году у нас появится ранняя версия AGI.

Хотя... если вам очень хочется - можете верить.

Но этого не произойдет к 2028 году, и любой AGI, который все же появится, будет построен на совершенно иной архитектуре. На какой именно? Думаю, мы узнаем это достаточно скоро.

-

Кому принадлежит Gemini?

-

Как работает Gemini?

-

Является ли Gemini точным?

-

Может ли Gemini помочь с конкретными задачами или вопросами?

-

Является ли Gemini бесплатным сервисом?

-

Можно ли использовать Gemini на мобильных устройствах?

-

Доступен ли Gemini на разных языках?

-

Как начать работу с Gemini?

Войти в Gemini: быстрый и безопасный доступ к вашему ИИ-помощнику

- Исследуйте возможности Gemini, передового ИИ от Google, созданного для преобразования вашей работы и творчества.

Что такое Gemini

- Gemini — это революционная разработка в области искусственного интеллекта, созданная компанией Google. Этот многофункциональный ИИ-помощник

Регистрация Gemini в России: Полное Руководство

- Gemini — это многофункциональный искусственный интеллект, способный генерировать тексты, переводить языки, писать код, анализировать данные и многое