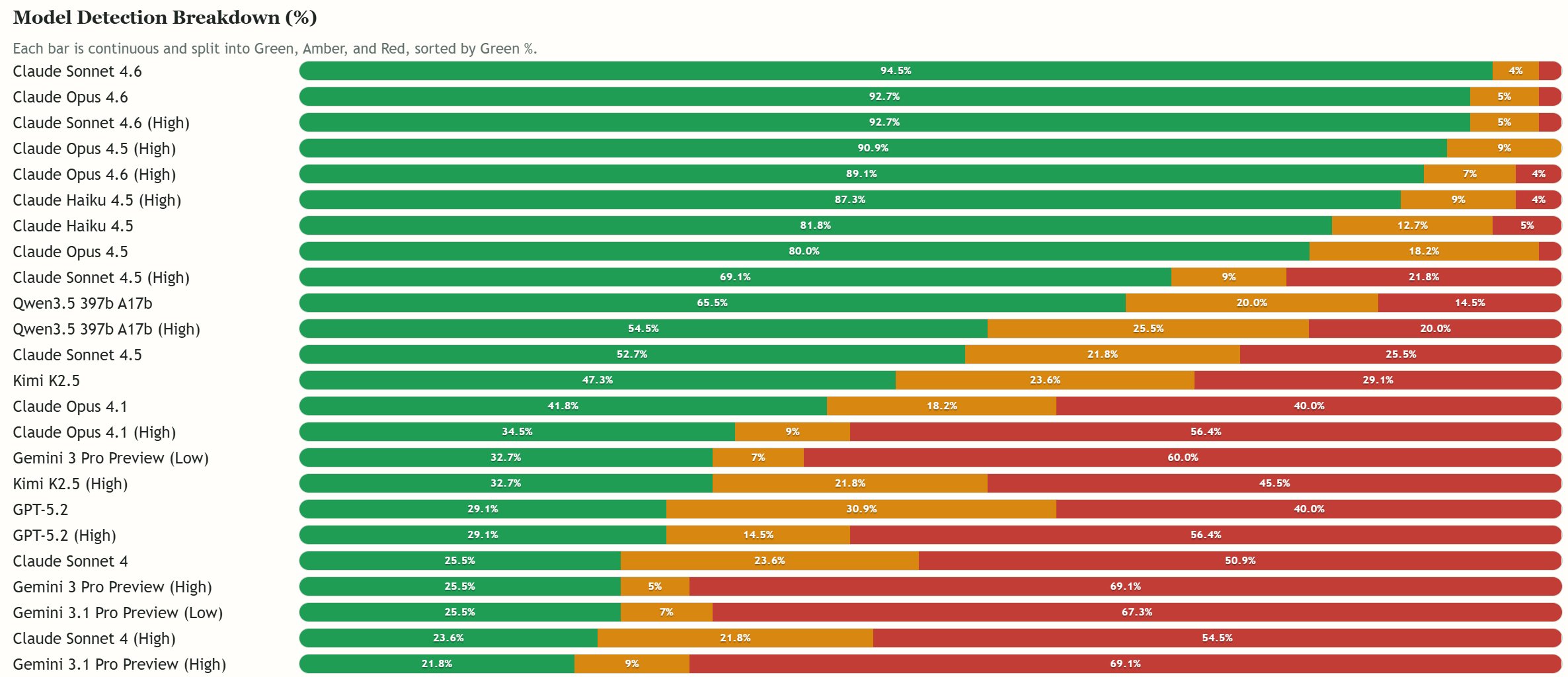

Gemini 3 бьёт рекорды, OpenAI гонит 1 000 токенов/сек и запускает рекламу в ChatGPT: главные новости AI за неделю

-

Google обновила Gemini 3 Deep Think: 48,4% на Humanity's Last Exam, 84,6% на ARC‑AGI-2, золото на IMO 2025 — и впервые открывает Deep Think через API для исследователей и инженеров.

-

OpenAI выпустила GPT-5.3-Codex‑Spark на чипах Cerebras: 1 000+ токенов/сек, первая модель для кодинга в реальном времени — research preview для ChatGPT Pro, курс на «двухрежимный» Codex.

-

Zhipu AI представила GLM-5 — 744B параметров под MIT License: по заявлению разработчиков, лучшая open‑source модель в кодинге и агентных задачах — на BrowseComp обходит все модели в таблице, на Vending Bench 2 приближается к Claude Opus 4.5.

-

Qwen выкатила Image-2.0 — генерация и редактирование в одной модели: промпты до 1 000 токенов, профессиональные инфографики, каллиграфия и фотореализм в 2K — бенчмарки пока только внутренние.

-

OpenAI обвинила DeepSeek в дистилляции американских моделей: меморандум направлен в Конгресс США — сотрудники DeepSeek якобы обходили ограничения доступа и писали код для извлечения данных, ответа от DeepSeek пока нет.

-

OpenAI запустила рекламу в ChatGPT: тест в США для планов Free и Go — реклама подбирается по теме диалога, рекламодатели не видят чаты, подписчики Pro/Business/Enterprise без рекламы.

Google выпустила обновлённый Gemini 3 Deep Think: рекорды на научных и алгоритмических бенчмарках и первый доступ через API

Google представила крупное обновление Gemini 3 Deep Think — специализированного режима рассуждений для науки, исследований и инженерии. Модель разрабатывали в тесном партнёрстве с учёными и исследователями, фокусируясь на задачах без чётких рамок, с неполными или зашумлёнными данными. Впервые Deep Think доступен через Gemini API.

Бенчмарки:

-

Humanity's Last Exam: 48,4% (без инструментов) — новый лучший результат.

-

ARC‑AGI-2: 84,6% — подтверждено ARC Prize Foundation.

-

Codeforces: Elo 3 455 — соревновательное программирование.

-

IMO 2025: уровень золотой медали.

-

IPhO и IChO 2025: уровень золотой медали на письменных частях.

-

CMT‑Benchmark (теоретическая физика): 50,5%.

Кейсы раннего доступа:

-

Математик из Rutgers University использовала Deep Think для рецензирования статьи — модель нашла логическую ошибку, которую пропустило обычное peer review.

-

Лаборатория Duke University оптимизировала методы выращивания кристаллов для поиска полупроводниковых материалов — Deep Think спроектировал рецепт для плёнок >100 μm.

-

Инженер из Google Platforms & Devices ускорил проектирование физических компонентов.

Практическое применение:

-

Помимо бенчмарков, Deep Think помогает интерпретировать сложные данные и моделировать физические системы через код.

Доступность:

-

В приложении Gemini для подписчиков Google AI Ultra — уже доступен.

-

Через Gemini API — для избранных участников early access (исследователи, инженеры и компании по заявке).

Google позиционирует Deep Think как инструмент для реальной научной работы, а не только для бенчмарков. Результаты впечатляющие: часть подтверждена независимо (ARC Prize Foundation), часть — собственные замеры Google.

OpenAI запустила GPT-5.3-Codex-Spark: первая модель для кодинга в реальном времени на чипах Cerebras — 1 000+ токенов в секунду

OpenAI выпустила research preview GPT-5.3-Codex‑Spark — компактную версию GPT-5.3-Codex, оптимизированную для интерактивной работы с кодом в реальном времени. Это первый результат партнёрства с Cerebras, анонсированного в январе. Модель выдаёт более 1 000 токенов/сек и доступна подписчикам ChatGPT Pro.

Ключевые параметры:

-

Скорость: 1 000+ токенов/сек на Cerebras Wafer Scale Engine 3.

-

Контекст: 128k, только текст.

-

Стиль работы: минимальные точечные правки, не запускает тесты автоматически — всё ради скорости.

-

Можно прерывать и перенаправлять модель прямо в процессе генерации.

Бенчмарки:

-

На SWE‑Bench Pro и Terminal‑Bench 2.0 показывает сильные результаты при значительно меньшем времени выполнения по сравнению с GPT-5.3-Codex.

Оптимизация инфраструктуры (для всех моделей Codex):

-

Persistent WebSocket‑соединение для стриминга + оптимизации в Responses API.

-

Overhead на roundtrip снижен на 80%, per‑token overhead — на 30%, time‑to‑first‑token — на 50%.

-

WebSocket включён по умолчанию для Spark, скоро станет дефолтом для всех моделей.

Cerebras + GPU:

-

Cerebras обеспечивает отдельный сверхнизколатентный tier для интерактивных сценариев.

-

GPU остаются основой для обучения и инференса с оптимальной стоимостью токена.

-

Оба типа железа можно комбинировать в рамках одной задачи.

Доступность:

-

Research preview для подписчиков ChatGPT Pro — приложение Codex, CLI, расширение VS Code.

-

API — для ограниченного круга дизайн‑партнёров, расширение в ближайшие недели.

-

Отдельные rate limits, не влияющие на стандартные лимиты.

-

При пиковом спросе возможны очереди и временные ограничения доступа.

Безопасность:

-

Модель прошла стандартные проверки, включая cyber‑relevant training.

-

По оценке OpenAI, не достигает порога Preparedness Framework по кибербезопасности и биологии.

Планы:

-

Codex движется к двум режимам: долгие автономные задачи (часы/дни) + интерактивная работа в реальном времени.

-

В перспективе режимы объединятся: интерактивный цикл с делегированием тяжёлых задач суб‑агентам.

-

Впереди — более крупные модели, длинный контекст, мультимодальный ввод.

Spark — первый шаг OpenAI к «двухрежимному» Codex: долгие автономные задачи плюс мгновенный интерактив. Партнёрство с Cerebras даёт отдельный сверхнизколатентный tier, а GPU остаются базой по стоимости и масштабу. Пока это research preview с ограниченным доступом.

Zhipu AI выпустила GLM-5: открытая модель на 744B параметров для системной инженерии и долгих агентных задач

Zhipu AI представила GLM-5 — открытую модель (MIT License) на 744B параметров (40B активных), нацеленную на сложную системную инженерию и долгосрочные агентные задачи. По заявлению разработчиков, GLM-5 показывает лучшие результаты среди всех open‑source моделей в рассуждениях, кодинге и агентных сценариях, сокращая разрыв с frontier‑моделями.

Масштабирование относительно GLM-4.5:

-

Параметры: 355B (32B активных) → 744B (40B активных).

-

Данные претрейна: 23T → 28,5T токенов.

-

Интеграция DeepSeek Sparse Attention (DSA) для снижения стоимости деплоя при сохранении длинного контекста.

Инфраструктура RL:

-

Разработали [slime](https://github.com/THUDM/slime) — асинхронную инфраструктуру для обучения с подкреплением, повышающую throughput и эффективность пост‑трейнинга.

Ключевые бенчмарки (режим Thinking):

-

HLE с инструментами: 50,4% (Kimi K2.5 — 51,8%, Claude Opus 4.5 — 43,4%).

-

SWE‑bench Verified: 77,8% (Claude Opus 4.5 — 80,9%, GPT-5.2 — 80,0%).

-

Terminal‑Bench 2.0 (Claude Code): 56,2% (original) / 61,1% (verified) — у Claude Opus 4.5 57,9% (значение без verified).

-

BrowseComp с context management: 75,9% — лучший результат среди всех моделей в таблице.

-

Vending Bench 2: $4 432 — № 1 среди open‑source (Claude Opus 4.5 — $4 967, Gemini 3.0 Pro — $5 478).

-

На внутреннем CC‑Bench‑V2 значительно превосходит GLM-4.7 по frontend, backend и долгосрочным задачам, приближаясь к Claude Opus 4.5.

Офисные задачи:

-

GLM-5 генерирует готовые.docx,.pdf и.xlsx из текстового описания — от финансовых отчётов до учебных планов.

-

На Z.ai раскатывается Agent mode со встроенными навыками создания документов.

Доступность:

-

Веса на Hugging Face и ModelScopeпод MIT License.

-

API: api.z.ai и BigModel.cn.

-

Совместимость с Claude Code и OpenClaw.

-

Бесплатно в чате Z.ai.

-

Поддержка локального деплоя: vLLM, SGLang, а также не‑NVIDIA чипы (Huawei Ascend, Moore Threads, Cambricon и др.).

-

GLM Coding Plan: GLM-5 раскатывается постепенно, начиная с Max‑подписчиков; потребляет больше квоты, чем GLM-4.7.

GLM-5 сокращает разрыв с frontier‑моделями: на ряде агентных бенчмарков приближается к Claude Opus 4.5, а на BrowseComp обходит всех конкурентов в таблице. Открытые веса под MIT — серьёзная заявка для open‑source сообщества. Часть бенчмарков проведена независимо (Vending Bench 2 — Andon Labs), остальные — собственные замеры.

Qwen представила Qwen-Image-2.0: профессиональные инфографики и фотореализм в одной модели

Команда Qwen (Alibaba) представила Qwen‑Image-2.0 — модель для генерации и редактирования изображений, объединяющая оба направления в единой архитектуре с поддержкой промптов до 1 000 токенов.

Ключевые возможности:

-

Типографика: генерация слайдов, постеров, комиксов и инфографик с точной отрисовкой текста на нескольких языках. Отдельно выделяют 5 качеств текстового рендера: точность, сложность, эстетика, реалистичность и выравнивание.

-

Фотореализм: нативное разрешение 2K с детализацией до пор кожи и текстуры ткани.

-

Семантическая точность: модель точнее следует смыслу сложных промптов.

-

Единая модель: генерация и редактирование без переключения между пайплайнами.

Архитектура:

-

Облегчённая архитектура — заявлен меньший размер модели и более быстрый инференс по сравнению с предшественниками.

-

В одном из демо‑промптов фигурирует схема «8B Qwen3-VL encoder → 7B diffusion decoder → 2048×2048».

Результаты:

-

Вышла в лидеры на бенчмарке AI Arena (Alibaba) в категориях text‑to‑image и image‑to‑image по результатам слепого тестирования.

-

Демонстрация: генерация полного текста «Предисловия к стихам павильона Орхидей» мелким почерком кайшу с минимальными ошибками.

Редактирование:

-

Нанесение каллиграфии на существующие фото.

-

Склейка двух изображений в реалистичное совместное фото.

-

Вставка мультяшных персонажей в реальные снимки.

Первая в линейке Qwen модель «два в одном» — генерация плюс редактирование. Главная фишка — работа с текстом внутри изображений: от слайдов до кинопостеров. Бенчмарки внутренние (AI Arena, Alibaba), независимых тестов пока нет.

OpenAI обвинила DeepSeek в дистилляции американских моделей — меморандум направлен в Конгресс США

OpenAI направила в комитет Палаты представителей США по стратегической конкуренции с Китаем меморандум, в котором обвиняет DeepSeek в систематическом использовании американских моделей для обучения собственных через дистилляцию. По данным Reuters, документ содержит конкретные утверждения о действиях сотрудников DeepSeek.

Суть обвинений:

-

OpenAI заявляет о «продолжающихся попытках DeepSeek бесплатно использовать возможности, разработанные OpenAI и другими frontier‑лабораториями США».

-

По утверждению OpenAI, аккаунты, связанные с сотрудниками DeepSeek, разрабатывали методы обхода ограничений доступа — через замаскированные сторонние роутеры и другие способы сокрытия источника запросов.

-

OpenAI также утверждает, что сотрудники DeepSeek писали код для программного доступа к американским моделям и получения выходных данных для дистилляции.

Что такое дистилляция в данном контексте:

-

Более мощная модель оценивает качество ответов новой модели, фактически передавая ей свои знания.

Дополнительные заявления OpenAI:

-

Китайские LLM «срезают углы в безопасном обучении и развёртывании новых моделей».

-

OpenAI проактивно удаляет пользователей, которые пытаются дистиллировать модели для создания конкурирующих продуктов.

Контекст:

-

DeepSeek и материнская компания High‑Flyer не ответили на запрос Reuters.

-

В начале прошлого года модели DeepSeek‑V3 и DeepSeek‑R1 вызвали резонанс на рынках, продемонстрировав конкурентоспособность с ведущими американскими моделями.

OpenAI переводит конкуренцию с DeepSeek в политическую плоскость, апеллируя напрямую к законодателям. Обвинения серьёзные, но пока основаны исключительно на заявлениях OpenAI — ответа DeepSeek на момент публикации Reuters не последовало.

OpenAI запустила тестирование рекламы в ChatGPT — старт в США для планов Free и Go

OpenAI начала показывать рекламу в ChatGPT совершеннолетним пользователям в США на подписках Free и Go. Подписчики Pro, Business и Enterprise рекламу не увидят. Компания подчёркивает, что реклама не влияет на ответы модели.

Как работает:

-

Реклама подбирается на основе темы текущего диалога, истории чатов и предыдущих взаимодействий с объявлениями.

-

Все объявления имеют спонсорскую пометку и визуально отделены от ответов ChatGPT.

-

Не показывается несовершеннолетним и рядом с чувствительными темами (здоровье, политика).

Конфиденциальность:

-

Рекламодатели не имеют доступа к чатам, истории, сохранённым данным или личной информации.

-

Рекламодатели видят только агрегированные метрики: просмотры и клики.

Пользовательский контроль:

-

Можно скрывать объявления, удалять рекламные данные, настраивать персонализацию.

-

Альтернатива: перейти на Plus/Pro или отключить рекламу в бесплатной версии (с сокращением числа бесплатных сообщений в день).

Зачем:

-

OpenAI объясняет рекламу необходимостью поддерживать инфраструктуру для сотен миллионов пользователей на бесплатных тарифах.

-

В перспективе — новые форматы, цели и модели размещения.

Сейчас это ранний тест с ограниченным охватом и набором защитных механизмов. OpenAI рассматривает рекламу как способ поддерживать Free и Go и будет решать о расширении по результатам тестирования и с развитием защитных механизмов.

Какая новость для вас главная? Пишите в комментариях!

-

Кому принадлежит Gemini?

-

Как работает Gemini?

-

Является ли Gemini точным?

-

Может ли Gemini помочь с конкретными задачами или вопросами?

-

Является ли Gemini бесплатным сервисом?

-

Можно ли использовать Gemini на мобильных устройствах?

-

Доступен ли Gemini на разных языках?

-

Как начать работу с Gemini?

Войти в Gemini: быстрый и безопасный доступ к вашему ИИ-помощнику

- Исследуйте возможности Gemini, передового ИИ от Google, созданного для преобразования вашей работы и творчества.

Что такое Gemini

- Gemini — это революционная разработка в области искусственного интеллекта, созданная компанией Google. Этот многофункциональный ИИ-помощник

Регистрация Gemini в России: Полное Руководство

- Gemini — это многофункциональный искусственный интеллект, способный генерировать тексты, переводить языки, писать код, анализировать данные и многое